论文链接:A Survey of Context Engineering for Large Language Models

摘要

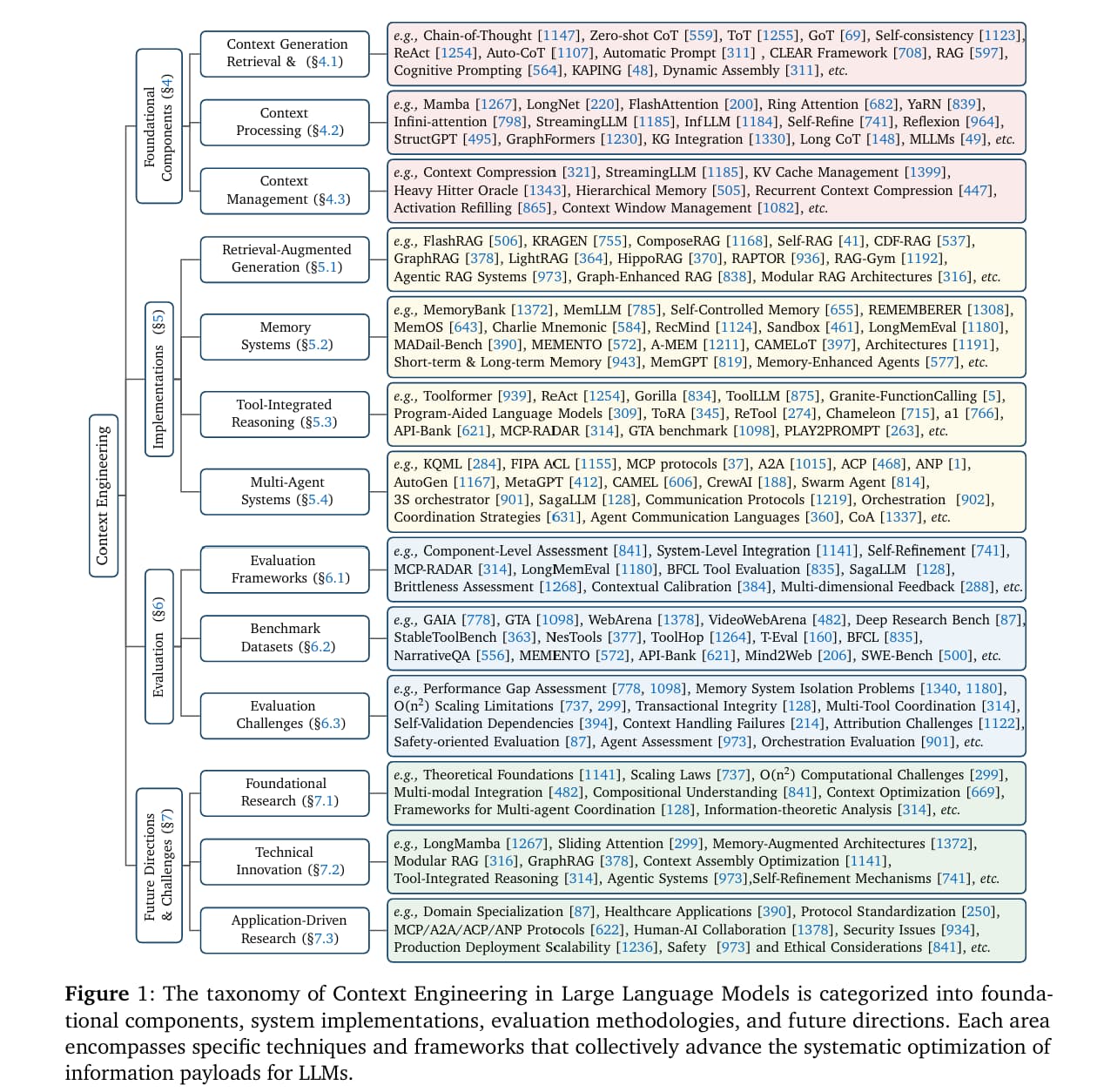

LLM 的表现从根本上由推理过程中提供的上下文信息所决定。此调查,介绍了上下文工程,一个正式的学科,它超越了简单的提示词也包括了 LLM 的信息负载的系统性优化。我们展示了完整的分类,将上下文工程拆解为基本的组件和复杂的集成到智能系统的执行。

首先研究基础的组件:

1)上下文检索与生成,包括基于提示词的生成和外部知识获取

2)上下文处理,应对长序列整合,自我优化,结构化数据整合

3)上下文管理,覆盖记忆层级、压缩和优化

然后探索这些基本组件是如何架构化集成来进行复杂的系统实现:

1)RAG 检索增强生成,包括模块化,智能体化和图增强体系结构;

2)记忆系统,实现持续性的互动;

3)工具集成推理,用以函数调用和环境交互;

4)多智能体系统,协调通信与编排;

通过系统性的对超过 1400 份论文的分析,我们的研究不仅在此领域技术路线也揭示了一个关键研究空白:模型能力之间存在这基础的非对称。尽管当前的大模型在优化的上下文工程的帮助下,展示了在理解复杂内容的令人印象深刻的能力,在生成足够复杂、绵长的输出时也显示出了明显的不足。解决这一落差是未来研究的主要任务。最终,本研究为针对 AI 上下文的研究人员和工程人员提供了一个统一的框架。

简介

LLM 的出现标志着人工智能领域范式的转移,它在自然语言理解、生成、推理方面展示了史无前例的能力。然而,模型的性能和有效性根本性的由他们收到的上下文来决定。上下文的覆盖范围包括:简单的指令提示词到复杂的外部知识库,通过这些主要的方法来操作模型的行为,增强模型的知识,释放模型的能力。随着模型从简单的指令遵循系统进化到复杂应用的核心推理引擎,设计、管理信息负载的方法相对应的进化到正式的学科:上下文工程 Context Engineering。

上下文工程的研究领域在爆炸性的增长,造成大量细分但是碎片化的研究领域出现。我们把这个情形概念化拆解为基本的组件和接下来的执行部署。基本的组件代表着通过3个关键阶段组成的系统性的上下文工程工作流:上下文检索和生成,包括基于提示词的生成和外部知识的获取;上下文处理,包括长序列处理,自我优化方法和结构化信息集成。上下文管理,主要是记忆层级、压缩技术和优化策略;

这些基本的组件是未来建造复杂的、面向连接 LLM 和外部实体的应用的建造基础。这些系统包括:高级检索增强生成 RAG,已经进化到模块化支持知识动态插入的智能体架构;显式记忆系统,模仿人类的认知功能持久化的保持信息;和整个智能体生态。后一个类目代表着上下文工程的塔尖,智能体利用函数调用和工具集成的推理和真实的世界进行交互,依赖于复杂的智能体通信协议和上下文编排完成在多智能体配置的复杂目标。

尽管每一个研究领域都产生了实质的创新,他们绝大多数都是割裂开的研究。碎片化的发展使得基础的技术之间的连接变得模糊,为研究人员探寻理解更广阔的视角造成屏障,为从业人员高效利用这些方法造成了阻碍。此领域亟需一个统一的框架系统性的组织不懂的技术,厘清原理,阐释他们相互之间的依赖与关联。

为弥补如此重要的缺口,本研究提供了第一个面向大语言模型上下文工程的全面且系统的综述。我们主要的贡献是提出了新颖的、结构化的体系,它可以对多方面的设计、管理、优化上下文的技术进行分类。本分类法将此领域组织为连贯的类别:区分基础组件和将他们集成到复杂系统的实现。通过此框架,我们

1)在每个领域提供清晰且结构化的最新总览

2)分析了不同方法的核心机制及优缺点

3)识别首要的挑战以及绘出未来研究的蓝图

本研究可以作为研究复杂的上下工程领域的技术路线图,也可以作为培育深度理解以及计划未来创新的基石。

余下内容按照如下组织。在定义上下文工程以及讨论相关的工作之后,我们首先研究了基础组件,囊括上下文获取与生成、上下文处理、上下文管理。我们之后探究了系统实现,包括:RAG 检索增强生成、记忆系统、工具集成推理和多智能体系统。最后,我们讨论了评估方法,未来的研究方向和本论文的总结。

相关作品

LLMs 大语言模型的快速成熟刺激了数量可观的描摹大语言模型多面情形的调查文献。这些现存的作品,尽管非常有价值,大部分都在我们定义的上下工程的大的领域之中研究一个明确的垂直的内容。我们的研究寻求补充这些贡献,提供一个水平的、统一的分类方法,其特点是区分基础组件和它们在复杂系统中的集成,从而在这些垂直的领域架起桥梁。